作者:Lilong Xue,Dan Zhang,Yuxiao Dong,Jie Tang

来源:arXiv:2507.03829v1

单位:ACL

发表日期:2024.8

一、论文介绍

背景动机:

大语言模型(LLM)在文本理解与生成任务上表现卓越,使其成为信息抽取(IE)领域的新方法来源。

当前绝大多方法聚焦于句子级关系抽取(SentRE),难以处理文档级任务(DocRE)

现有 LLM 方法主要依赖“将所有关系作为候选加入提示词”,不适用于大关系集场景。

研究目标:

提出 AutoRE:一种结合 LLM 的端到端 DocRE 模型。

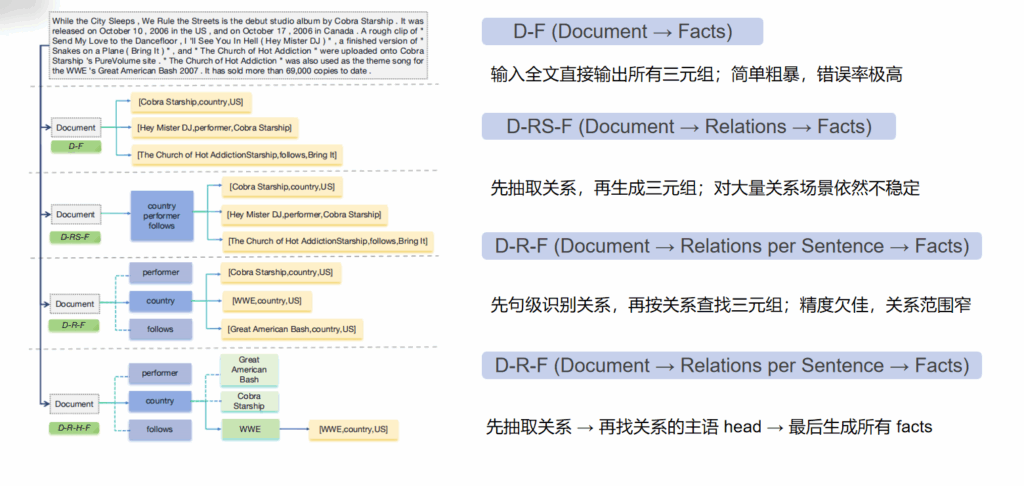

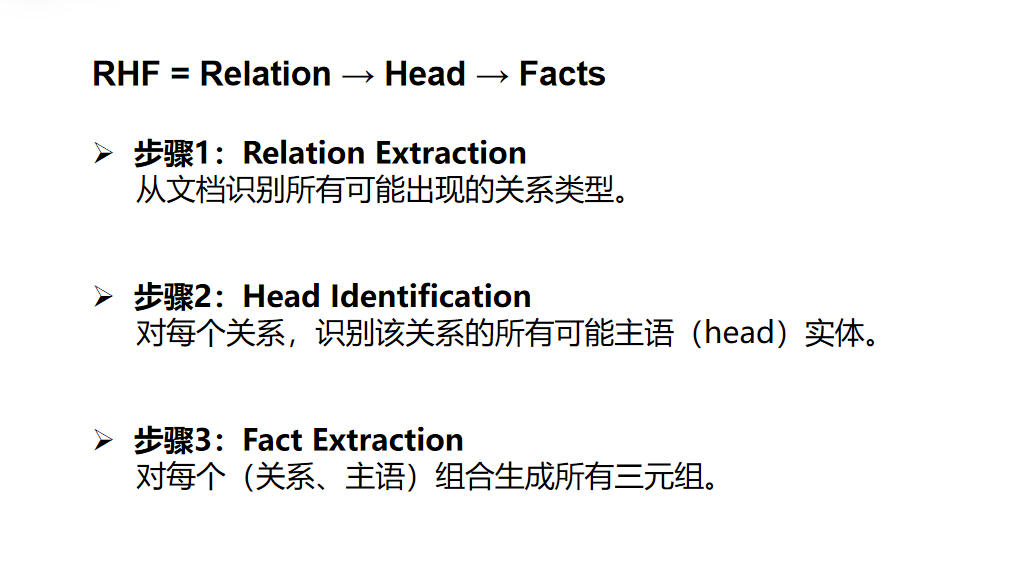

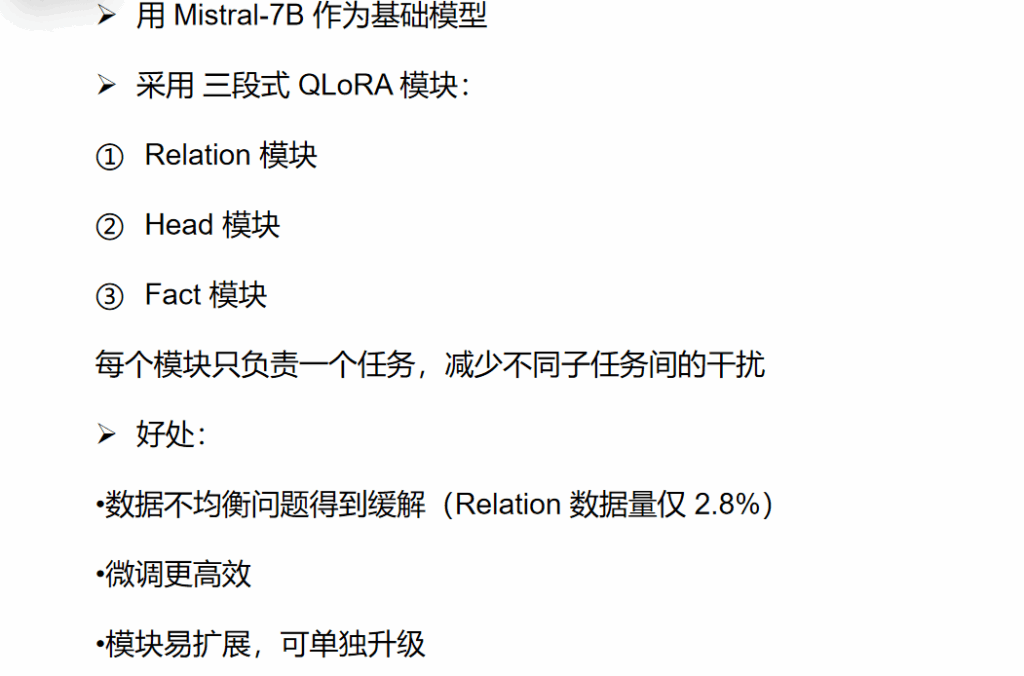

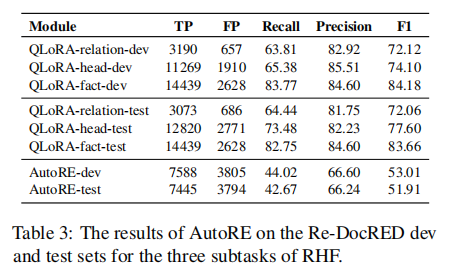

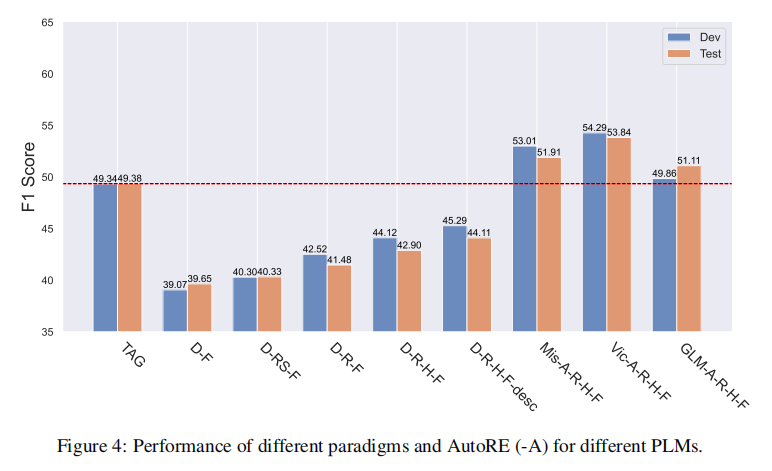

引入全新抽取范式 RHF(Relation → Head → Facts),摆脱“已知关系集”假设。利用 QLoRA 实现高效参数高效微调,使模型适应 DocRE 的多关系、多三元组特性。在 Re-DocRED 数据集上实现 SOTA 性能,显著超过现有最佳方法 TAG。

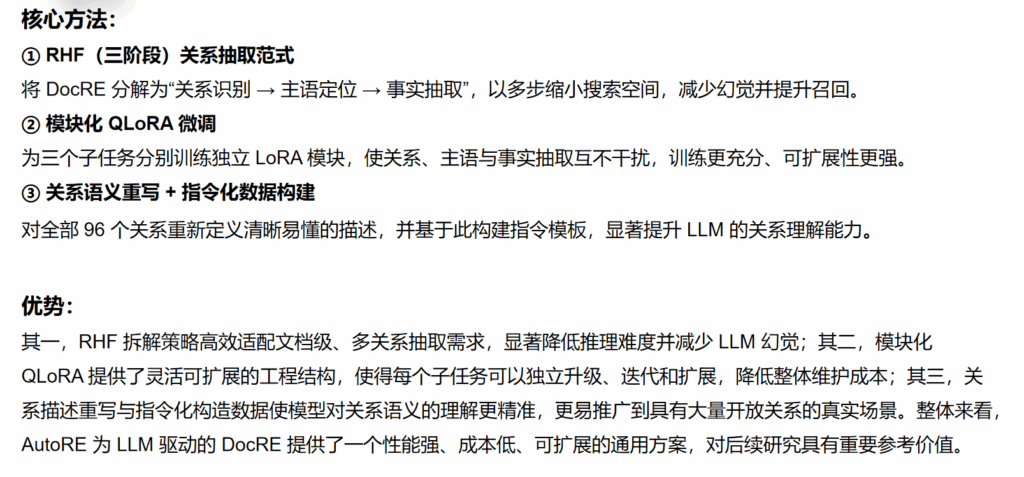

二、核心内容

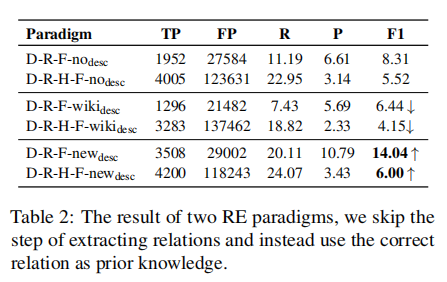

三、实验评估

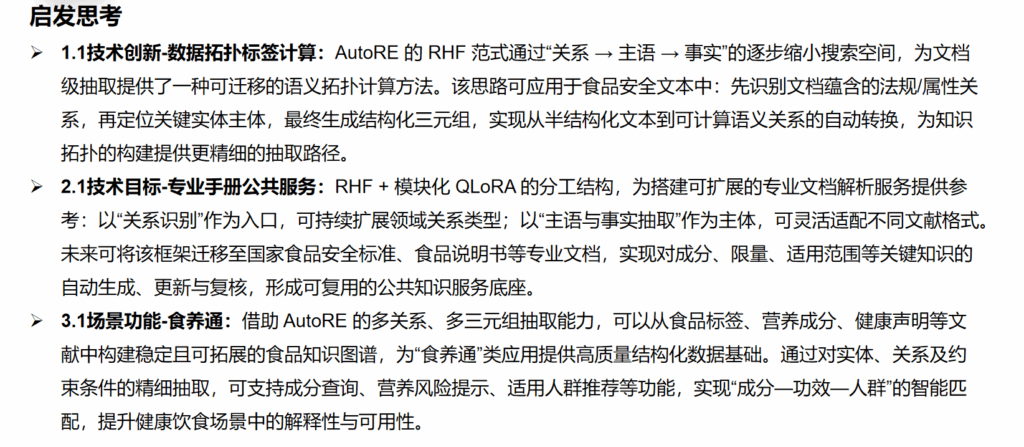

四、总结思考