作者:Song Yang,Jiamou Liu,Kaiqi Zhao

单位:新西兰奥克兰大学

来源:ACM SIGIR’22

一、研究背景

三个关键问题:

1、如何从签到序列中聚合信息以形成全局轨迹流模式的统一表示?

2、如何保留这些轨迹流之外的重要时空上下文信息,如类别信息和用户偏好?

3、如何在下一个POI推荐中利用上述所有信息,在通用运动模式和个性化需求之间取得平衡?

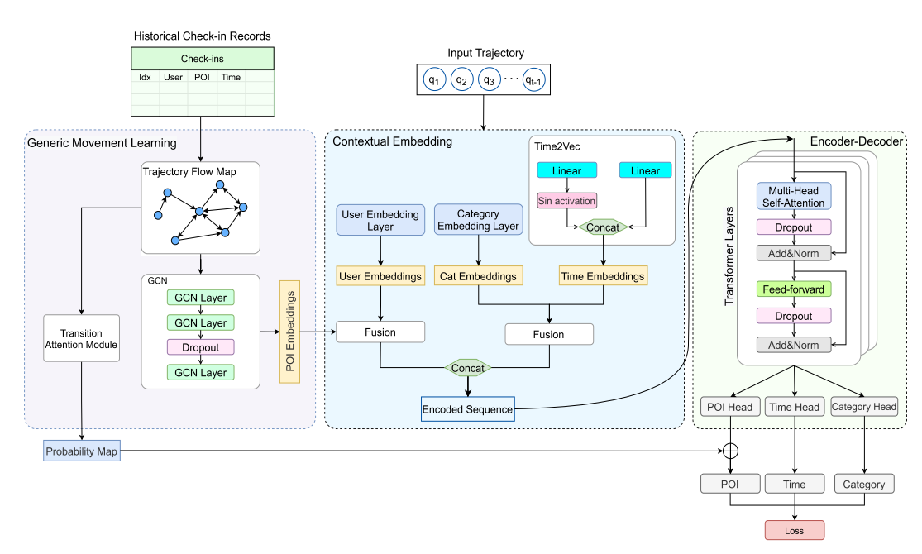

对于问题1,该论文构建了新颖的(用户不可知的)轨迹流图,该轨迹流图在单个图结构中总结了POI之间的轨迹以及每个POI的特征。该图中的节点是具有包括地理位置、类别和登记计数的属性的POI。

对于问题2,利用嵌入层来捕捉用户的偏好、POI类别嵌入,以及time2vec模型来描述时间嵌入。为了将它们连接在一起,类别和时间嵌入被合并并馈送到融合模块以产生时间感知的类别上下文嵌入。

对于问题3,在GETNext中,该论文采用了Transformer编码器和多层感知器(MLP)解码器来集成POI嵌入和其他个性化嵌入中编码的隐式全局流模式。此外,全局流模式也通过学习的转移注意图显式地注入到最终预测中。

该论文的主要贡献总结如下:

1、提出了一个全局轨迹流图来模拟常见的访问顺序转换信息,并利用图卷积网络将其编码为POI嵌入。

2、开发了一种新的时间感知类别上下文嵌入捕获POI类别的不同时间模式。

3、提出了一个基于transformer的框架,整合全局过渡模式,用户的兴趣爱好、短期轨迹和结合时空背景的下一个POI推荐在一起。

二、技术思想

基于轨迹流图学习

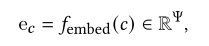

兴趣点嵌入:轨迹流图中的节点代表 POI,每个节点包含经纬度、类别、签到次数等属性。如果两个 POI 在同一个轨迹中按顺序被访问,则它们之间存在一条有向边,边的权重表示它们共同出现的频率。同时利用 GCN 的能力捕捉节点之间的拓扑关系,并聚合邻居节点的信息来更新节点嵌入,并使用多个 GCN 层堆叠来提高模型的表示能力。

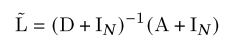

计算图拉普拉斯矩阵的归一化形式:

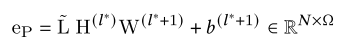

使用 GCN 层的权重矩阵对节点特征矩阵进行线性变换,将线性变换后的结果与归一化拉普拉斯矩阵相乘,并加上偏置项:

GCN模块的输出:

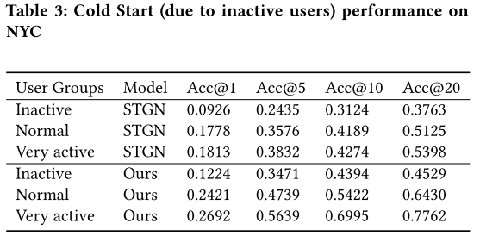

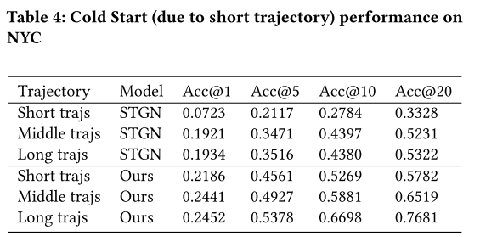

POI 嵌入过程利用 GCN 对轨迹流图进行学习,得到每个 POI 的向量表示,从而捕捉用户在 POI 之间的通用运动模式,并缓解冷启动问题。

转换注意力图:虽然 POI 嵌入能够捕捉 POI 之间的通用运动模式,但它并不能直接反映 POI 之间的转换概率。转换注意力图旨在显式地表示从一个 POI 转移到另一个 POI 的概率,从而更好地指导 POI 推荐。

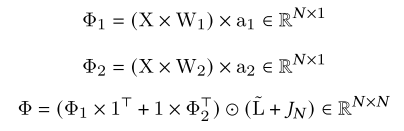

给定输入节点特征和G,将注意力图Φ计算为:

使用两个可学习的特征变换矩阵将输入节点特征映射到低维空间,构造一个注意力矩阵。将注意力矩阵与归一化拉普拉斯矩阵相乘,并进行元素级乘法操作。将结果进行归一化,得到最终的转换注意力图。

转换注意力图能够显式地建模 POI 之间的转换概率,并有效地指导 POI 推荐,从而提高推荐准确性。

上下文嵌入模块

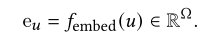

兴趣点-用户嵌入融合:POI嵌入是从轨迹流图中学习的,并且省略了用户特定的模式。为了捕捉特定用户的一般行为,该模型训练了一个嵌入层,将每个用户投影到一个低维向量上。

将连接的向量馈送到密集层中,以微调融合嵌入并增加其表示能力。输出可以表示为

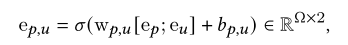

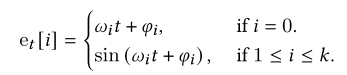

时间-类别嵌入融合:用户的访问行为自然具有时间依赖性。与兴趣点-用户嵌入融合模块类似,首先采用一种最先进的时间编码模型time 2 vector对兴趣点类别和时间进行编码。

时间编码:

类别编码:

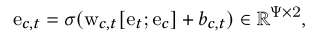

融合时间嵌入e和类别嵌入e,通过密集层形成单个类别时间表示:

Transformer编码器和MLP解码器

Transformer编码器:GETNext 使用多层 Transformer 编码器,每层都包含多头自注意力模块和前馈网络,并通过残差连接和归一化层进行连接。Transformer 编码器将输入轨迹的签到嵌入编码到一个特征空间中,为后续的 POI 预测提供丰富的信息。

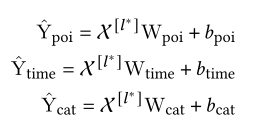

MLP解码器:GETNext 使用多个 MLP 解码器来预测用户的下一个 POI、访问时间和 POI 类别。每个 MLP 解码器都接收 Transformer 编码器的输出作为输入,并使用线性层和激活函数进行预测。

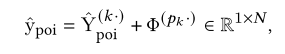

POI 解码器的输出经过与转换注意力图的残差连接,以增强全局转换模式对最终预测的影响:

三、实验

实验设置

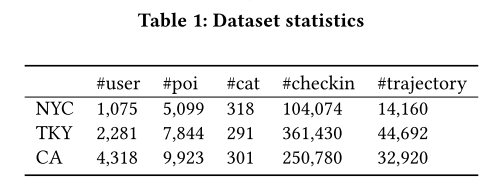

数据集:

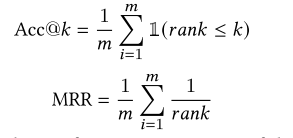

评估指标:

基线模型:

MF是解决推荐问题的经典方法。它通过矩阵分解学习用户和兴趣点的潜在表示。

FPMC将矩阵分解和马尔可夫链结合在一起,对用户的长期偏好和顺序行为进行建模。

LSTM是RNN模型的变体,用于处理序列数据。与标准的RNN模型相比,LSTM可以同时对短期和长期序列模式进行建模。

PRME提出了一种称为个性化排名度量嵌入的成对嵌入方法,以捕获用户偏好和POI之间的顺序转换。

ST-RNN 采用时间,距离转移矩阵来建模本地时间和空间上下文,以及用于用户序列模式捕获的RNN。

STGN通过添加空间门和时间门来扩展传统的LSTM,以捕获用户在空间和时间维度上的偏好。

STGCN 是STGN的更新版本,使用耦合输入和遗忘门。

PLSPL 通过注意力机制学习用户的长期品味,并通过LSTM学习短期偏好,并通过个性化的线性层将其结合起来。

STAN 利用具有自注意层的轨迹上沿着签到的时空信息来捕获非相邻签到之间的点对点交互。

实验结果

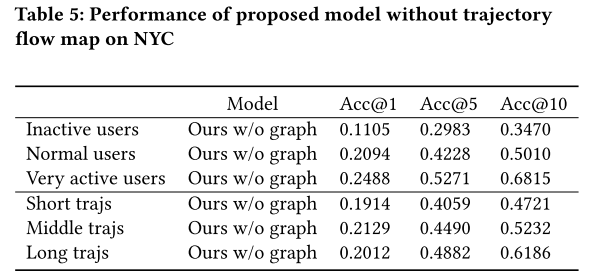

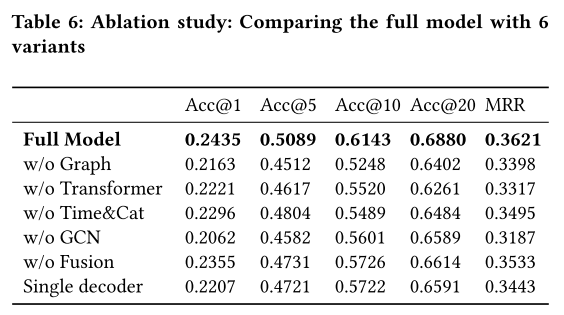

消融实验:

1)完整的模型;

2)没有轨迹流图,通过嵌入层学习POI嵌入;

3)没有Transformer编码器,序列数据由LSTM处理;

4)没有时间和类别信息;

5)没有GCN,使用随机游走从transtion图学习节点嵌入;

6)不是融合用户和POI嵌入,而是直接连接它们;

7)没有时间解码器和类别解码器。在每个实验中,与完整模型中一样,静止设置保持不变,并且仅替换或移除一个组件。

四、总结

GETNext 是一种基于图增强 Transformer 的模型,旨在解决下一代 POI 推荐问题,即预测用户下一步可能访问的地点。该模型的主要优势在于:

1、轨迹流图: 构建了一个全局轨迹流图,该图总结了用户在 POI 之间的常见访问顺序,并通过 GCN 将其嵌入到 POI 嵌入中。这有助于解决冷启动问题,特别是对于不活跃用户和短轨迹。

2、时间感知类别嵌入: 结合了 POI 类别嵌入和时间嵌入,以捕捉不同 POI 类别的不同时间模式。

3、Transformer 编码器和多层感知器解码器: 使用 Transformer 编码器来学习轨迹中的有用信息,并使用多层感知器解码器来预测用户下一步的 POI、访问时间和 POI 类别。

4、过渡注意力图: 明确地模拟了从一个 POI 到另一个 POI 的转换概率,并将其用于调整最终的推荐结果。

课题综合对齐思考

1、可以借鉴 GETNext 的轨迹流图思想,构建文旅用户在景点之间的轨迹流图,捕捉用户访问景点的常见顺序和规律。可以分析轨迹流图中的空间结构,预测用户未来可能访问的景点区域。

2、GETNext 的用户嵌入思想值得学习,学习用户的长期兴趣和短期兴趣,并结合时间感知类别嵌入,构建用户兴趣模型。

3、GETNext 使用了Transformer 编码器和 MLP 解码器,并结合用户兴趣模型和景点特征模型,设计个性化的兴趣点推荐算法。

4、可以借鉴 GETNext 的注意力机制,关注用户历史轨迹中重要的信息,例如高频访问景点、特定时间段访问的景点等。同时包括GETNext 的 GCN 思想,学习用户之间的社交关系,以及景点之间的关联关系,构建更全面的文旅用户兴趣模型。