- 作者:Fan Q, Pei W, Tai Y W等

- 来源:European Conference on Computer Vision. Cham: Springer Nature Switzerland, 2022

- 单位:快手科技、香港特别行政区研究资助局和国家自然科学基金基金

- 论文链接:arxiv.org/pdf/2207.11549

一、研究背景

- 当前的小样本分割方法仍然严重地受到提供的小样本支持而导致的类内变化的有限覆盖的影响,比如由黑马找到白马。

- 基于简单格式塔原理,即属于同一对象的像素比属于同一类的不同对象的像素更相似,本文提出了一种新的自支持匹配策略来缓解这一问题,该策略使用查询原型来匹配查询特征,其中查询原型是从高置信度查询预测中收集的。

- 该策略可以有效地捕获查询对象的一致底层特征,从而匹配查询特征。

- 还提出了自适应自支持背景原型生成模块和自支持损失,以进一步促进自支持匹配过程。

- 自支持网络大大提高了原型质量,受益于更强的主干和更多支持,并在多个数据集上实现了SOTA。

总结:

存在的问题: support和query同类目标之间存在的外观差异,属于类内差异

动机: 基于简单格式塔原理,即属于同一目标的像素比属于同—类的不同目标的像素更相似。

二、本文贡献

- 提出新颖的自支撑匹配,构建新颖的自支撑网络,解决FSS中的外观差异问题

- 提出了自支撑原型、自适应自支撑背景原型和自支撑损失

- 自支持方法受益于更强大的主干网和更多的支持,并且在多个数据集上优于以前的 SOTA,具有许多理想的优势

三、整体框架

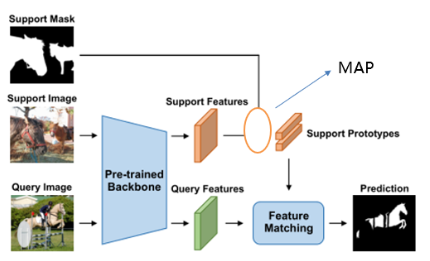

1、主流小样本分割模型

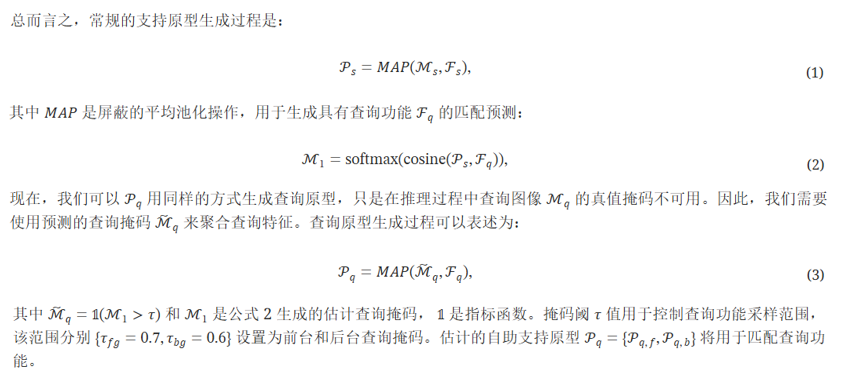

2、整体自支持网络架构

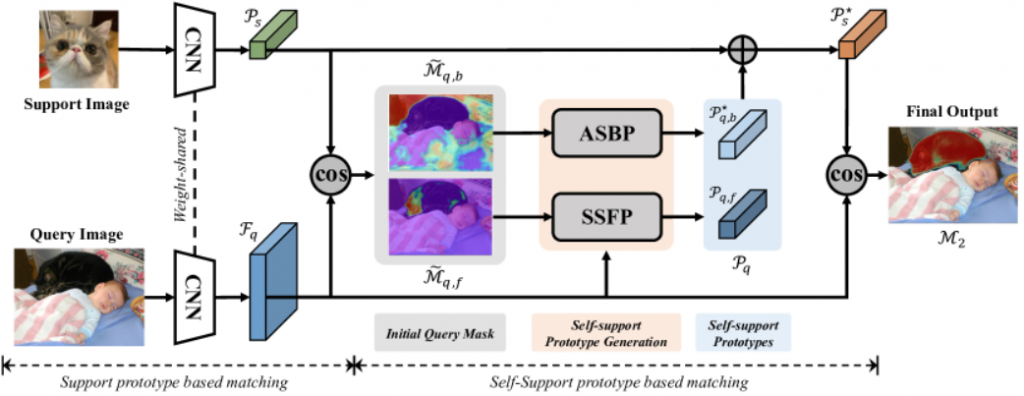

核心思想:聚合查询功能以生成查询原型并使用它自支持查询功能本身

为每个查询像素自适应地生成自支持背景原型

四、实验

实验设置

- 数据集:在两个FSS基准数据集上进行了实验:PASCAL-5i和COCO-20i。将数据分成四个部分进行交叉验证,其中三个部分用于训练,其余部分用于评估。在推理过程中,随机抽样1000和4000个支持查询对,分别对PASCAL-5i和COCO-20i进行评估。使用常用的平均交集(mloU,↑)作为在1-shot和5-shot设置下评估模型的评价标准。还将平均绝对误差(MAE,↓)来评估预测质量。

- 实现细节:采用在ImageNet上预训练的流行ResNet-50和101作为主干。放弃了最后一个主干阶段和最后一个ReLU,以获得更好的泛化。使用SGD以0.9动量和1e-3初始学习速率优化模型,该初始学习速率每2000次迭代衰减10次。该模型被训练6000次迭代,其中每个训练批包含4个支持查询对。图像和mask都被调整大小并裁剪成(473、473),并通过随机水平翻转进行增强。对原始图像执行评估。

实验结果

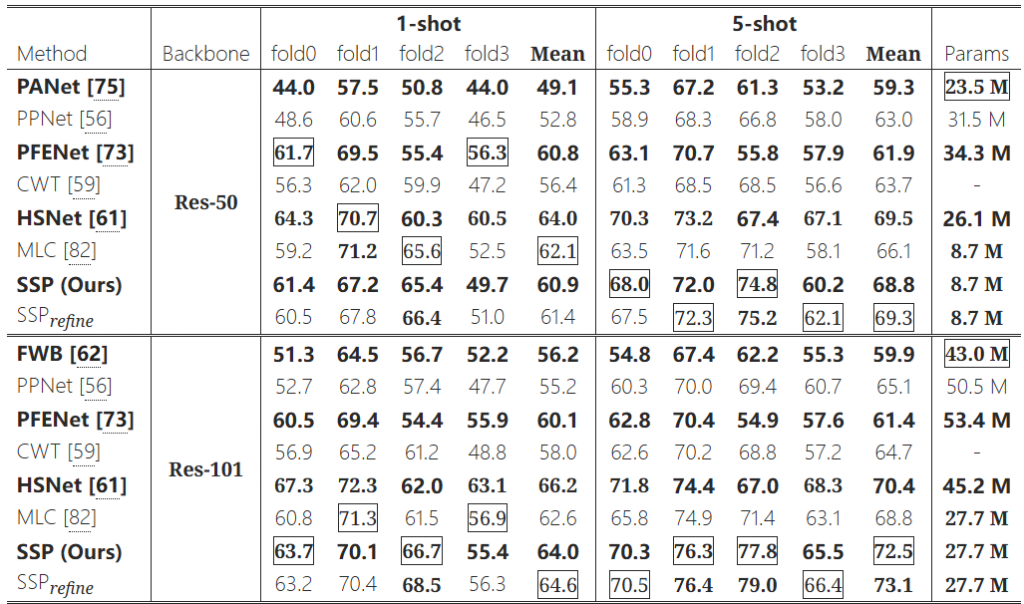

1、PASCAL-5i数据集地定量比较结果

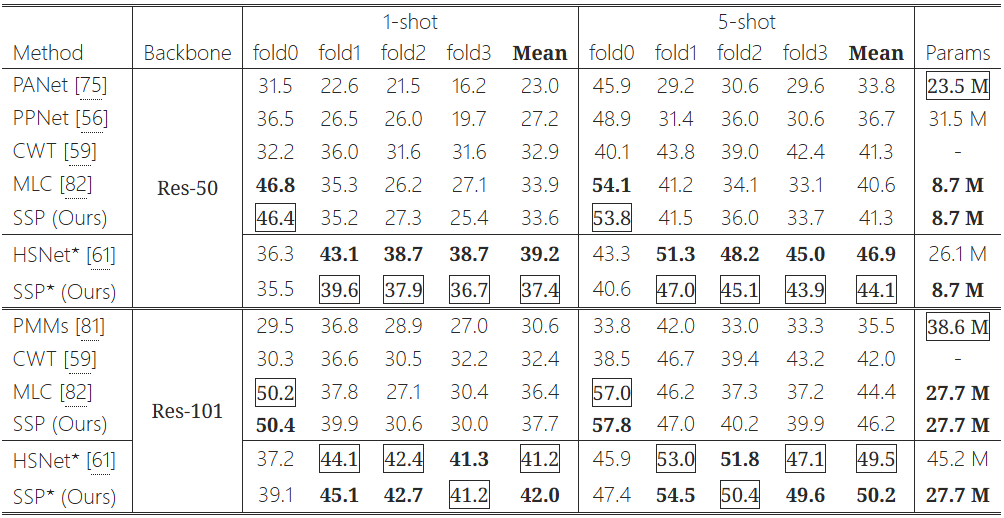

2、COCO-20i数据集地定量比较结果,*表示将根据HSNET地评估协议进行评估

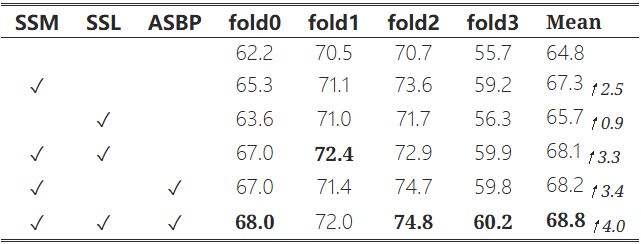

3、自支持模型的消融结果

SSL:自支持损失

ASBP:自适应的自支持背景原型

· 自支持模块可显着提高2.5%的性能

· 基线模型还受益于自支持损失的额外监督,自支持损失进一步促进了自支撑程序,并将表现提高到68.1%

· 配备了自适应自支撑背景原型后,自支撑模块可以获得额外的0.9%增益。

· 整合所有模块,本文的自支持方法显着将绩效从64.8%提高到68.8%,基于强基线

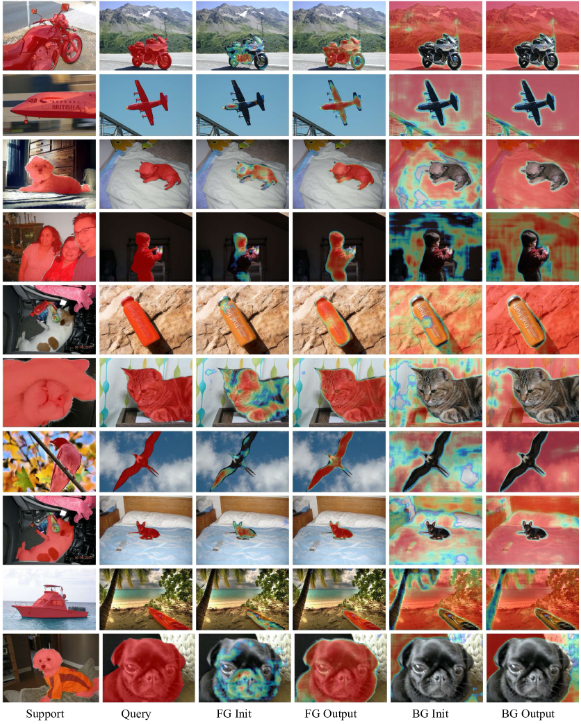

4、更多量化结果

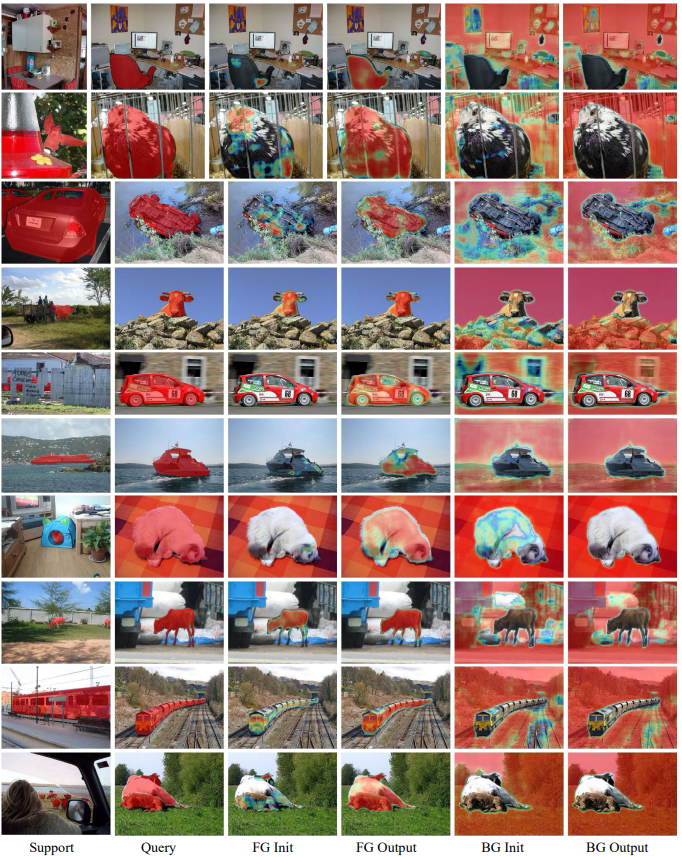

使用 ResNet-50 主干在 1次设置中呈现更定性的结果,以获得更好的可视化效果。

五、总结

- 在本文中利用查询特征生成自支持原型,并与查询特征进行自支持匹配,从而解决了少镜头分割中固有的关键类内外观差异问题。这一策略有效缩小了支持原型与查询特征之间的差距。

- 此外,文中还提出了自适应自支持背景原型和自支持损失,以促进自支持过程。

- 本文的自支持网络具有各种理想特性,并在多个基准测试中实现了 SOTA。通过大量实验和分析对自我支持程序进行了深入研究,以证实其有效性并加深对其工作机制的理解