来源:NIPS 2017

作者: Pan Ji, Tong Zhang, Hongdong Li, Mathieu Salzmann, Ian Reid

单位:阿德莱德大学;澳大利亚国立大学;

一、论文主要工作与贡献

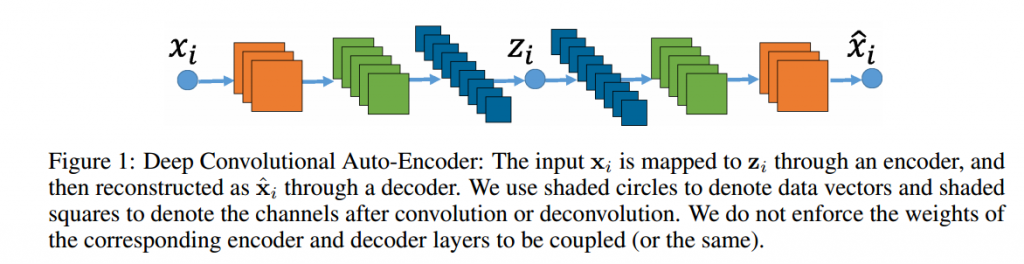

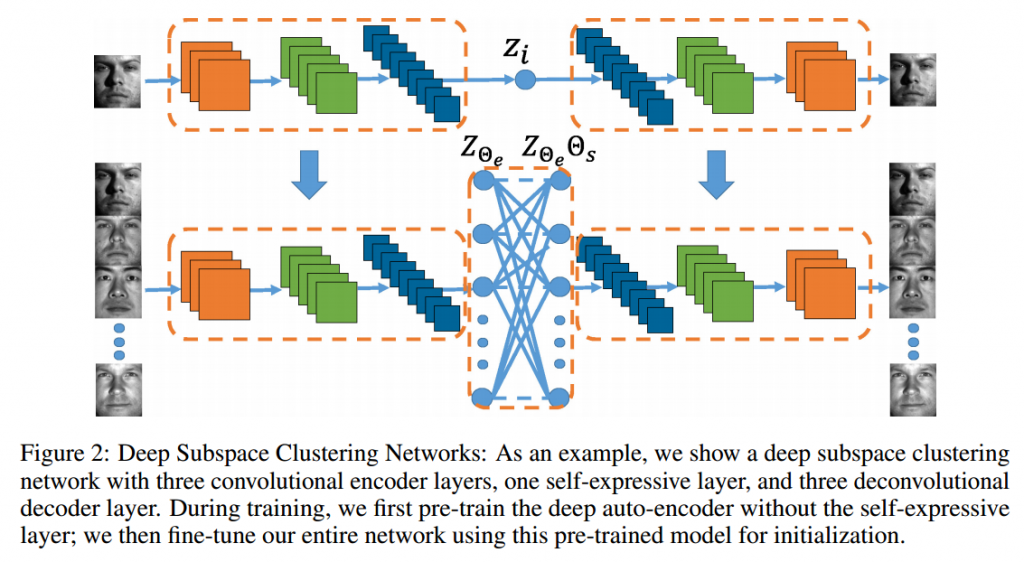

1.本文提出了一种新的用于无监督子空间聚类的深度神经网络结构。该架构建立在深度自编码器上,它将输入数据非线性地映射到潜在空间。关键思想是在编码器和解码器之间引入一个新的自表达层,以模仿在传统子空间聚类中被证明有效的“自表达”特性。

2.贡献包括在编码器和解码器之间的连接处引入一个新的自表达层——一个没有偏置和非线性激活的全连接层。这一层编码了从子空间并集中提取的数据的“自表达性”属性,即每个数据样本可以表示为同一子空间中其他样本的线性组合。

3.这篇论文第一次尝试直接学习一个神经网络中所有数据点之间的亲和力(通过组合系数)。

二、模型

2.1自编码器模型

2.2自表达层

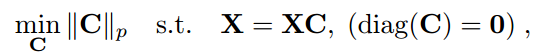

2.2.1自表达约束

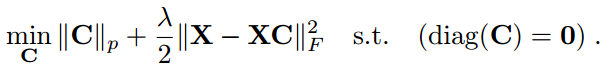

为了考虑数据损坏,上面的等式约束通常作为正则化项放宽:

2.3深度自编码模型中的自表达层

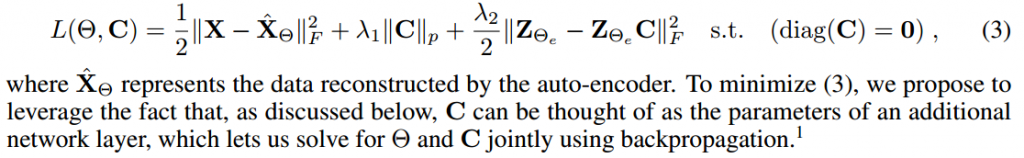

自表达层的权重对应于(3)中的矩阵C,进一步用于构建所有数据点之间的亲和力。

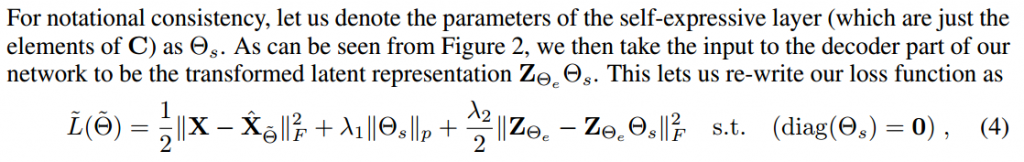

最终的损失函数定义:

2.4模型框架图

三、实验

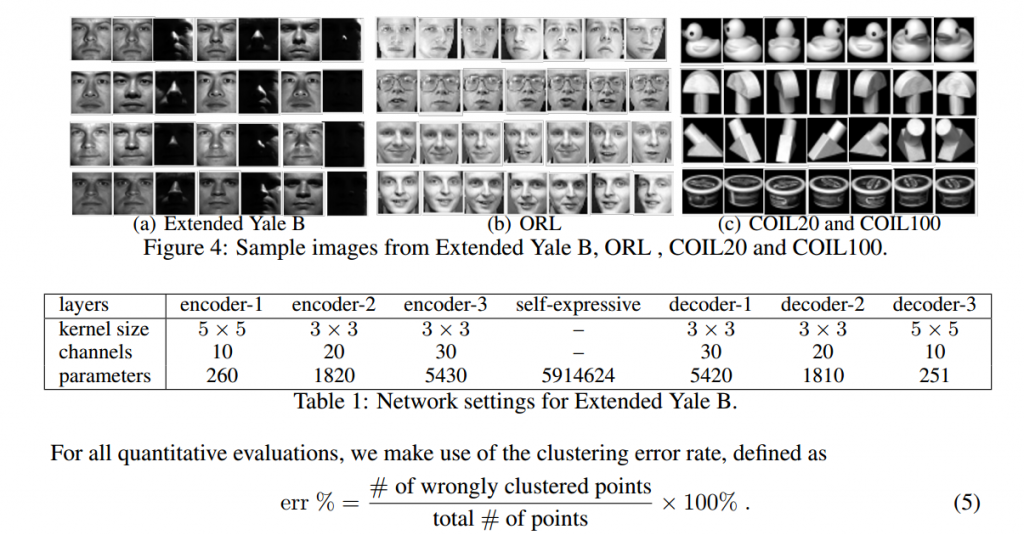

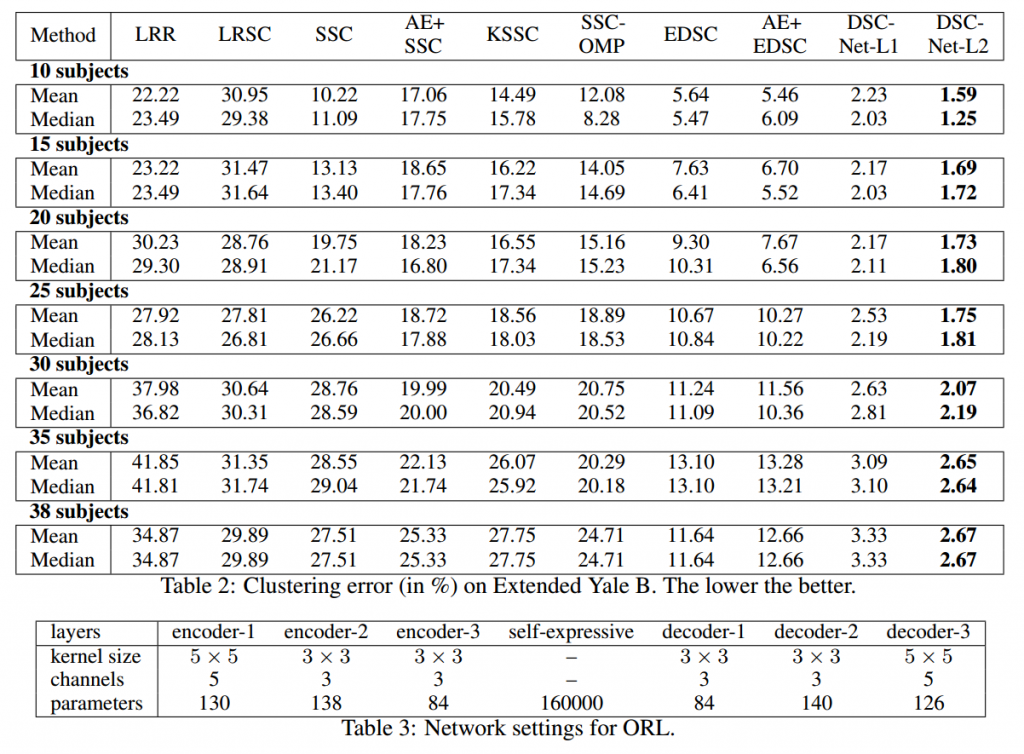

3.1数据集与参数配置

3.2实验结果

四、总结与思考

1.本文开发一种新的自表达层来利用子空间并集的“自表达性”特性,为子空间聚类引入了一个深度自编码器框架。

2.子空间聚类网络允许通过一个神经网络直接学习所有数据点之间的亲和力。但是受限于数据的规模毕竟将大规模数据一次性输入到网络中进行训练和学习亲和矩阵不现实。

3.可以尝试一个新的方向,维护一个独立的子空间,允许小批量训练,最后通过数据之间的关联聚类。