论文来源:CVPR2023

作者单位:三星AI研究所、多伦多大学

作者:Ashkan Mirzaei, Tristan Aumentado-Armstrong

一、论文主要工作

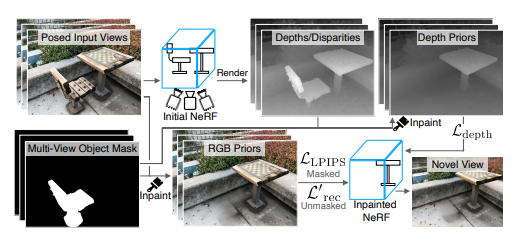

本文提出了一种新颖的修复方法来解决3D修复多视图一致的问题。给定单个输入图像中的一小组姿势图像和稀疏注释,本文的框架首先快速获得目标对象的3D分割掩模。然后使用掩模引入基于感知优化的方法,该方法利用学习的2D图像修复器,将其信息提取到3D空间,同时确保视图一致性。本文还通过引入由具有挑战性的现实世界场景组成的数据集来解决缺乏评估3D场景修复方法的多样化基准的问题。

二、论文贡献

1.3D 场景操作的完整过程,接受场景的多视图图像,从而实现用户交互最少的对象选择,紧接着完成 3D 修复 NeRF 场景;

2.为了执行此类选择,将 2D 分割模型扩展到多视图情况,能够从稀疏注释中恢复 3D 一致的掩模;

3.为了确保视图一致性和感知合理性,NeRF 中基于优化的 3D 修复新颖的公式利用了 2D 修复器;

4.用于 3D 对象去除评估的新数据集,其中包括相应的无对象真值。

三、方法

1.从单视图获取3D掩码

将有关对象和源视图的稀疏信息被提供给交互式分割模型,以估计初始源对象掩模𝑀^1,然后将训练视图视为视频序列,并与𝑀^1一起提供给视频实例分割模型 V

2.多视图分割(拟合NeRF)

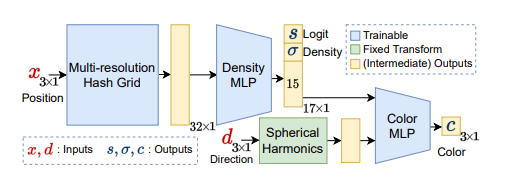

多视图分割模块采用输入 RGB 图像{𝐼𝑖}𝑖=1𝑛、相应的相机内在和外在参数以及初始掩模{𝑀^𝑖}𝑖=1𝑛,并训练语义 NeRF,从而得到整体损失。

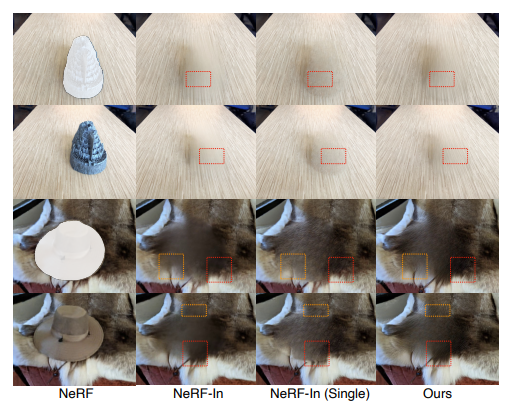

3.多视图修复

由于数据缺乏,无法直接训练 3D 修复器,本文的方法利用现有的 2D 修复器来获取深度和外观先验,然后监督 NeRF 与已完成场景的拟合。

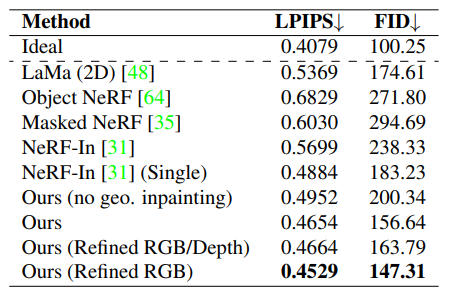

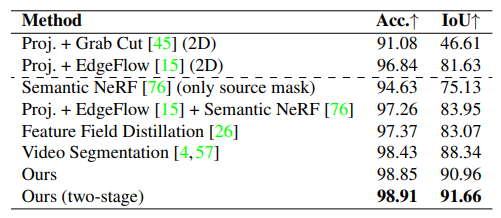

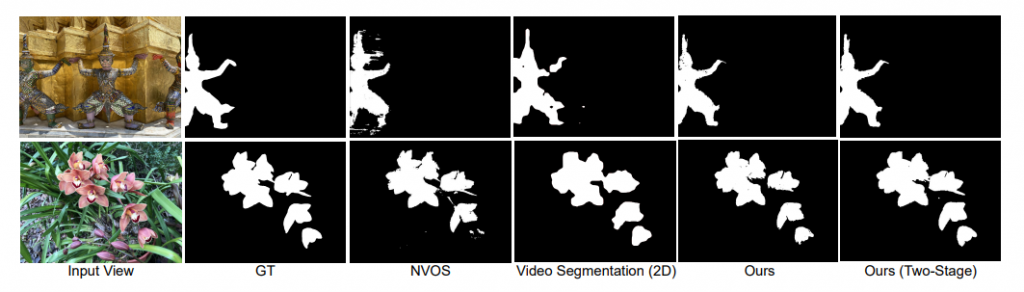

四、实验

1.多视图分割模型评估(定量/定性)

2.变异和消融实验

五、总结

1.本文提出了一种修复 NeRF 场景的新颖方法,该方法在给定单视图对象掩模的情况下,基于图像和几何先验来增强视点一致性。

2.本文提供了一种多视图分割方法,通过对不需要的对象(及其周围)使用一组稀疏像素级点击,并将它们转换为可以从新视图渲染的 3D 掩模,从而简化了注释过程。

3.本文引入了一个数据集,它可以很好地解决多视图修复缺乏挑战性基准的问题。